Nós Centrais

Aprenda sobre os nós centrais do ComfyUI para manipulação de imagens, condicionamento e muito mais. Construa fluxos de trabalho poderosos de arte com IA.

Imagem

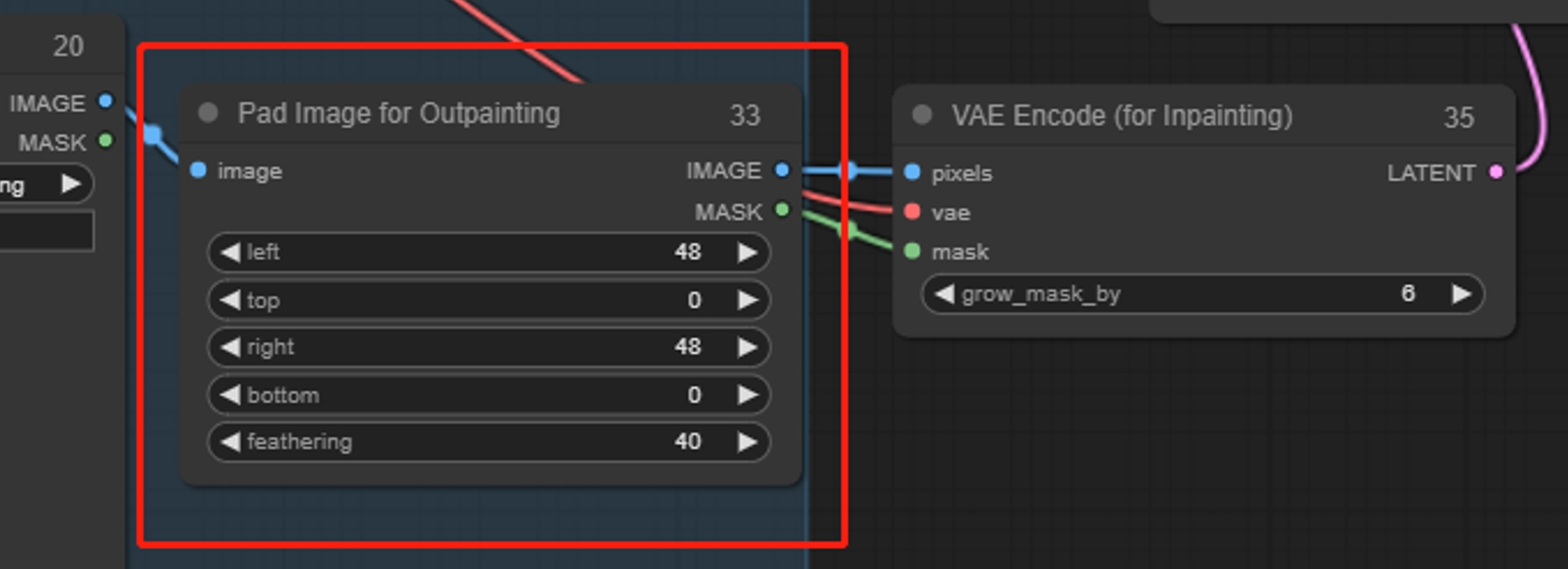

Pad Image for Outpainting (Preencher Imagem para Outpainting)

Preencher e estender a imagem, similar à expansão. Primeiro aumente o tamanho da imagem, depois desenhe a área expandida como uma máscara. É recomendado usar o VAE Encode (for Inpainting) para garantir que a imagem original permaneça inalterada.

Parâmetros:

left、top、right、bottom: Quantidades de Preenchimento para Cima, Baixo, Esquerda e Direita

feathering: Grau de Suavização da Borda

Save Image (Salvar Imagem)

Load Image (Carregar Imagem)

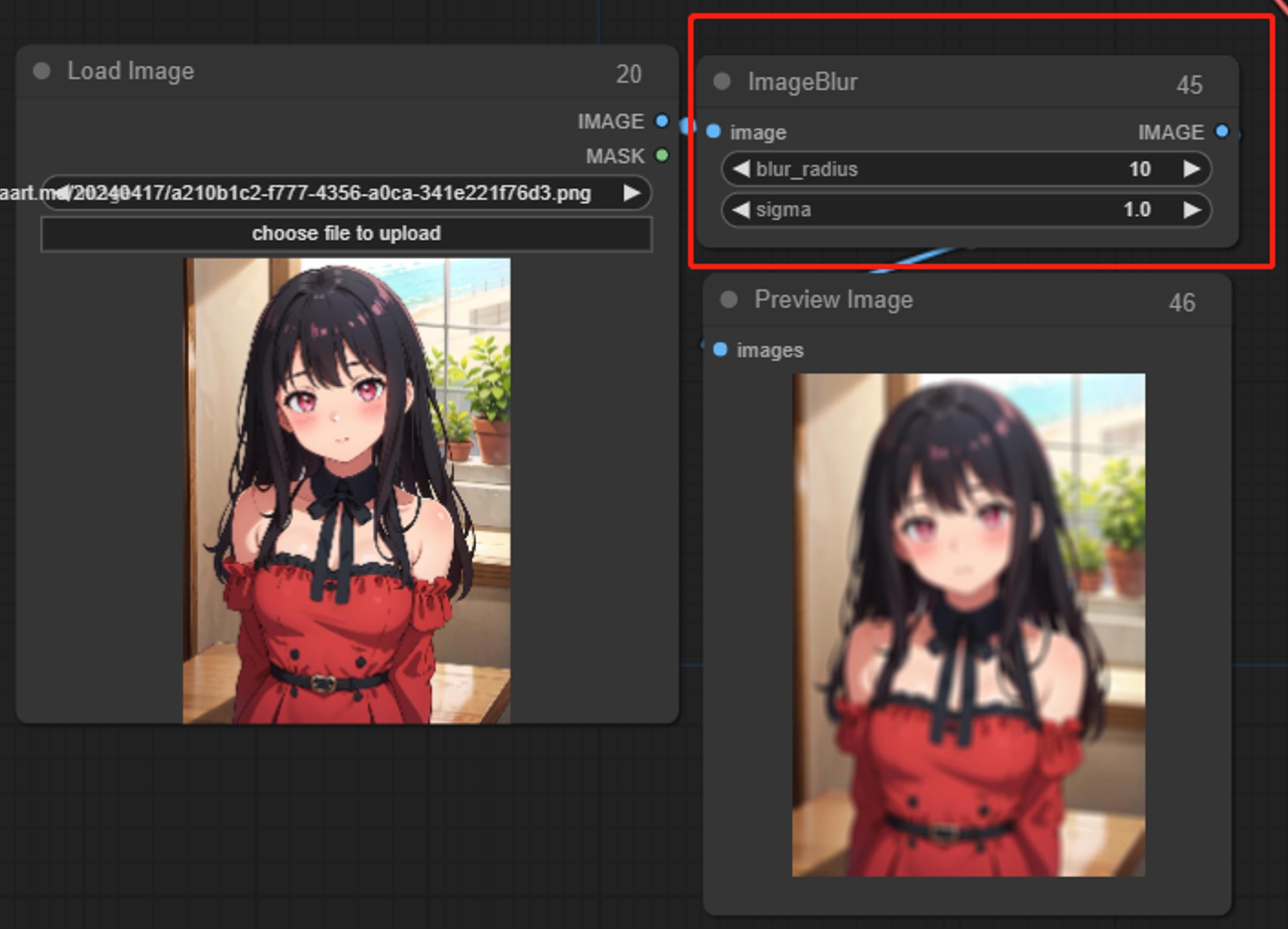

ImageBlur (Desfoque de Imagem)

Adicionar um Efeito de Desfoque à Imagem

Parâmetros:

sigma: Quanto menor o valor, mais concentrado o desfoque fica ao redor do pixel central.

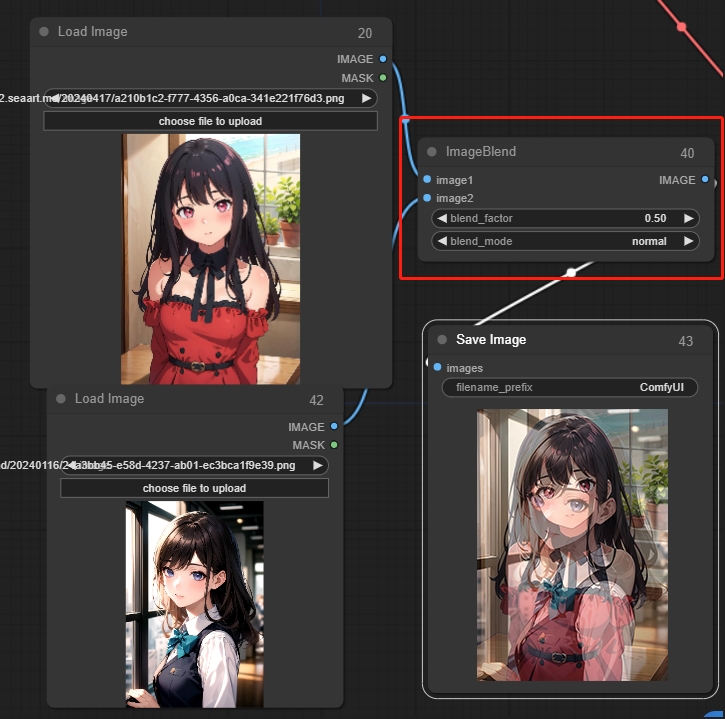

Image Blend (Mesclar Imagem)

Você pode misturar duas imagens usando transparência.

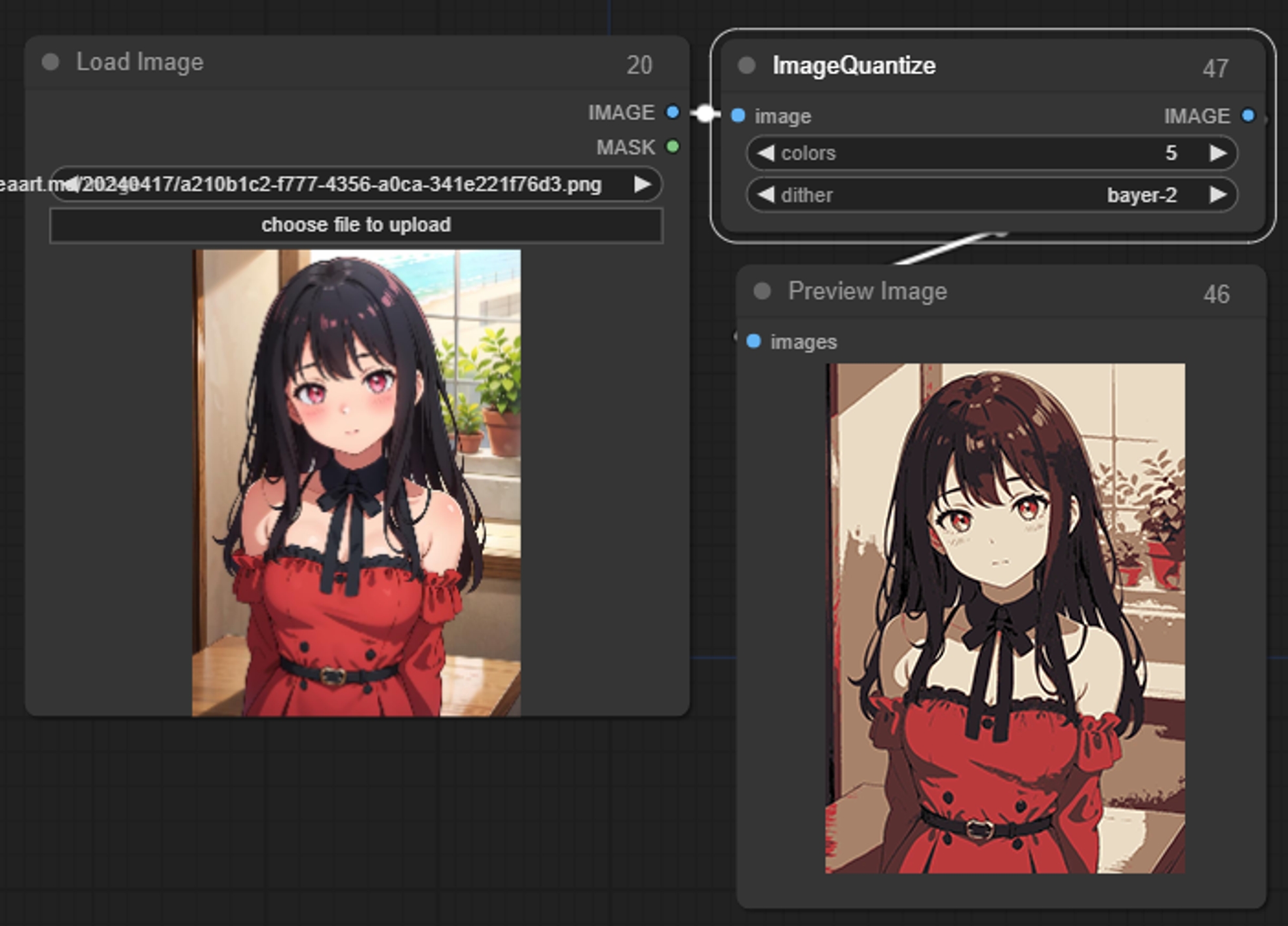

Image Quantize (Quantizar Imagem)

Reduzir o número de cores na imagem

Parâmetros:

colors: Quantizar o número de cores na imagem. Quando definido como 1, a imagem terá apenas uma cor.

dither: Se usar pontilhamento para fazer a imagem quantizada parecer mais suave

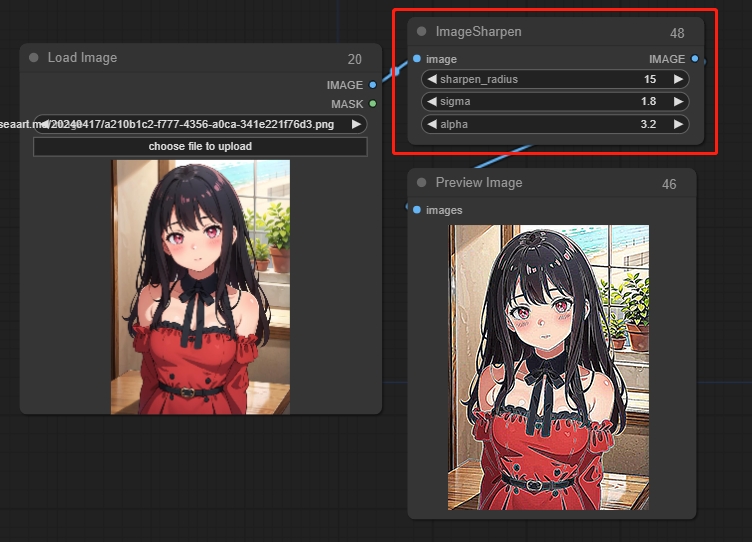

Image Sharpen (Nitidez de Imagem)

Parâmetros:

sigma: Quanto menor o valor, mais concentrada a nitidez fica ao redor do pixel central.

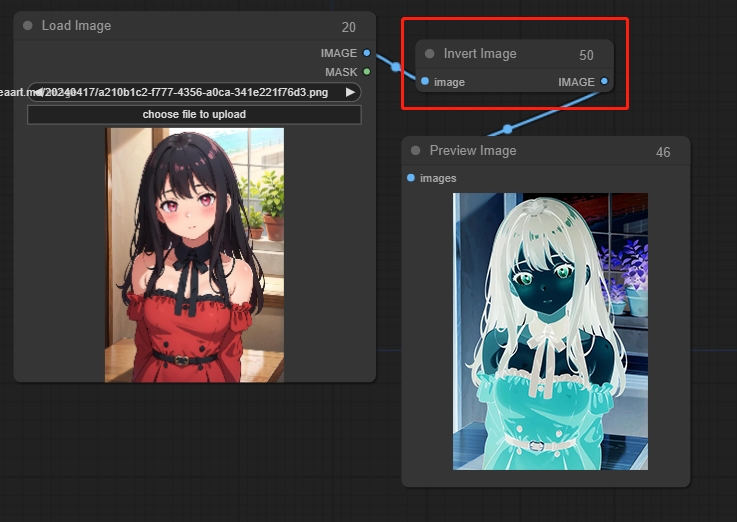

Invert Image (Inverter Imagem)

Inverter as cores da imagem

Upscaling (Aumentar Resolução)

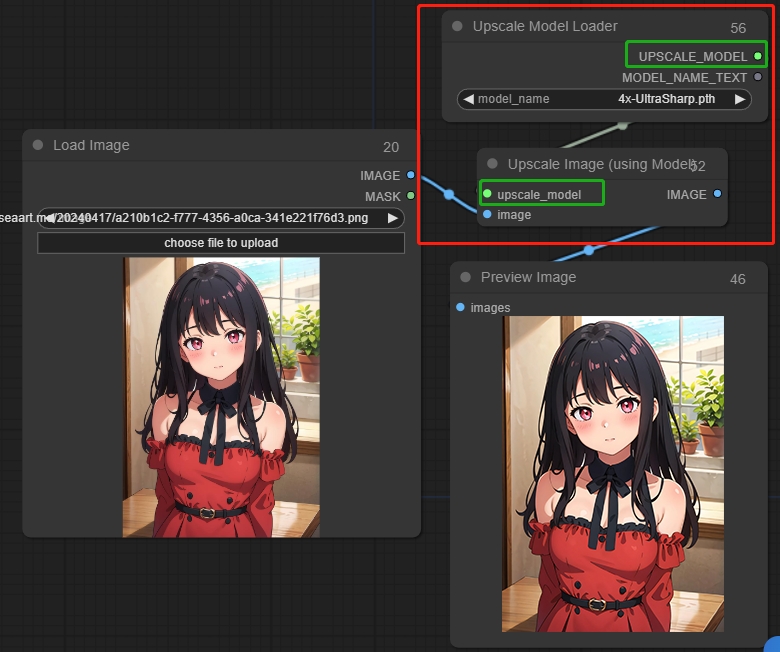

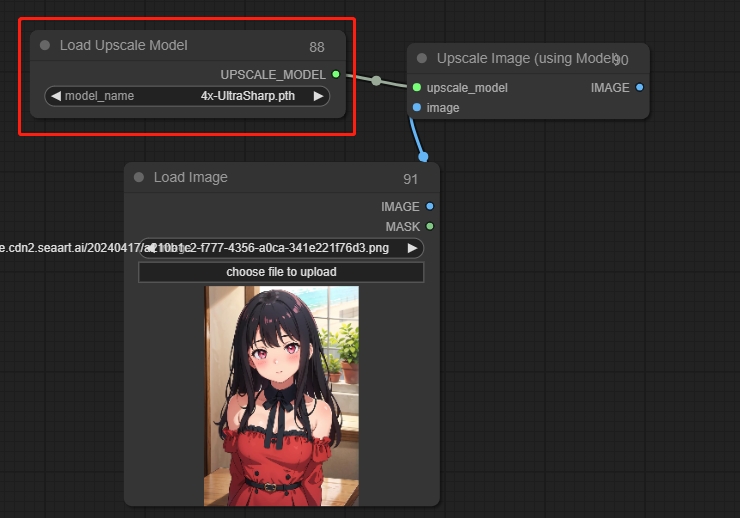

9.1 Upscale Image (Using Model) - Aumentar Resolução da Imagem (Usando Modelo)

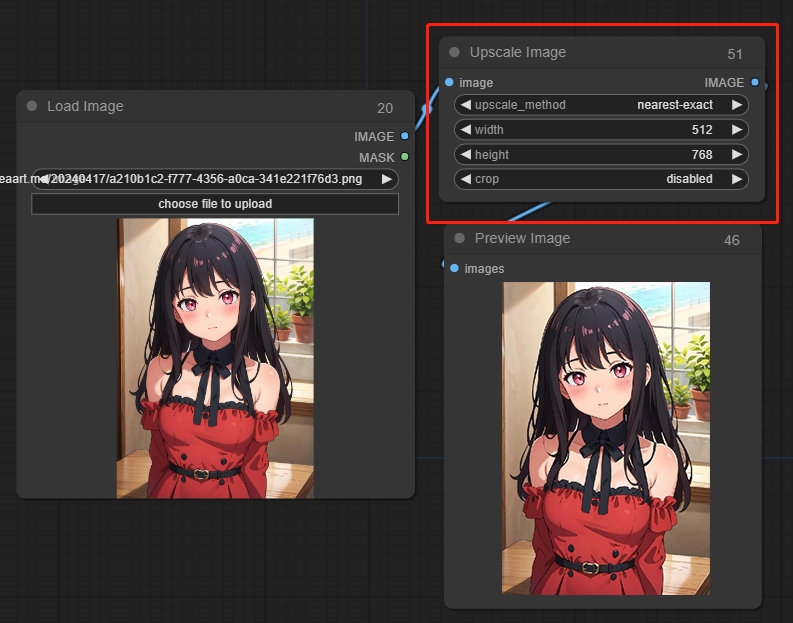

9.2 Upscale Image (Aumentar Resolução da Imagem)

O nó Upscale Image pode ser usado para redimensionar imagens de pixel.

Parâmetros:

upscale_method: Selecionar o método de preenchimento de pixel.

width: A largura ajustada da imagem

height: A altura ajustada da imagem

crop: Se cortar a imagem

Preview Image (Visualizar Imagem)

Loaders (Carregadores)

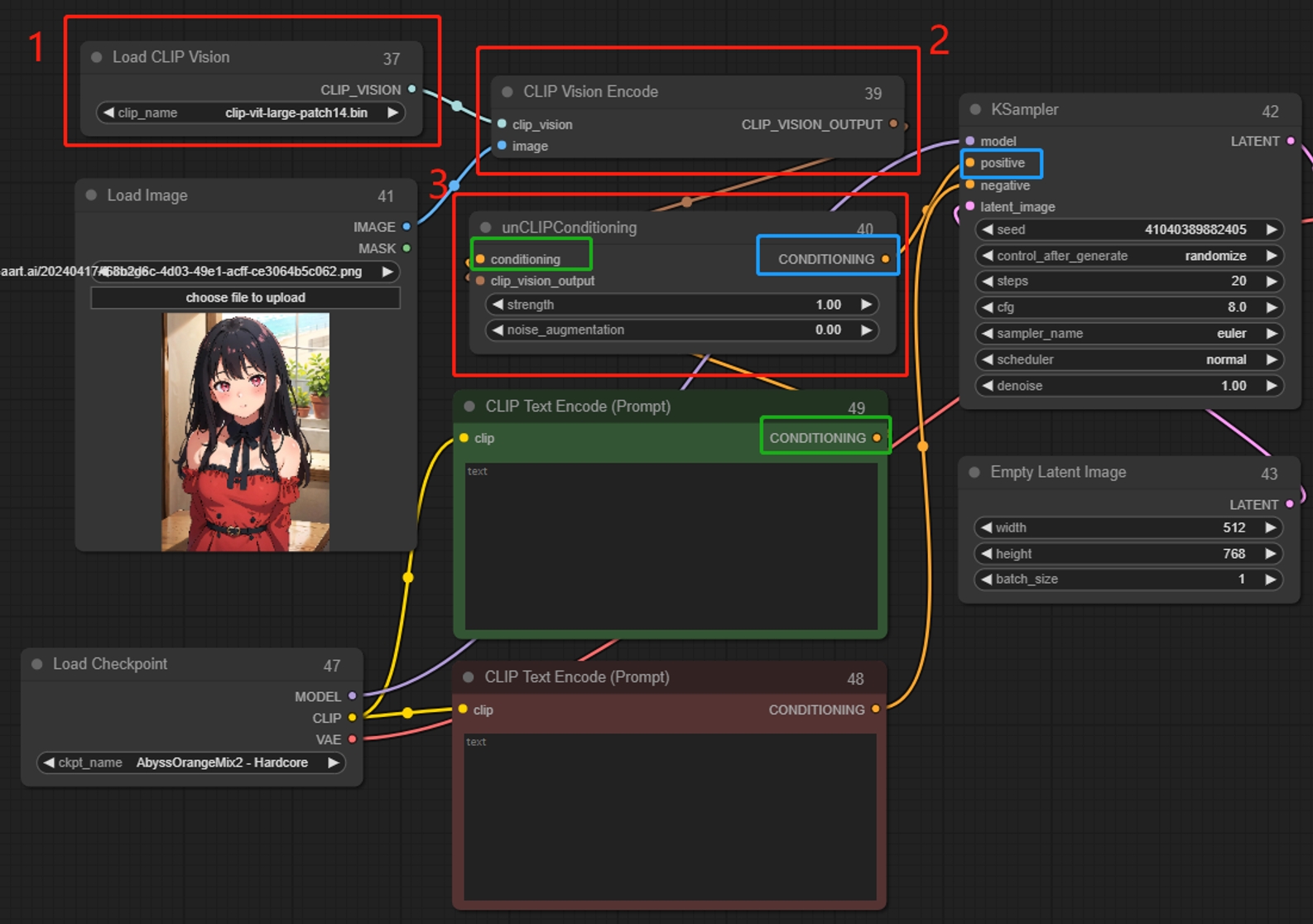

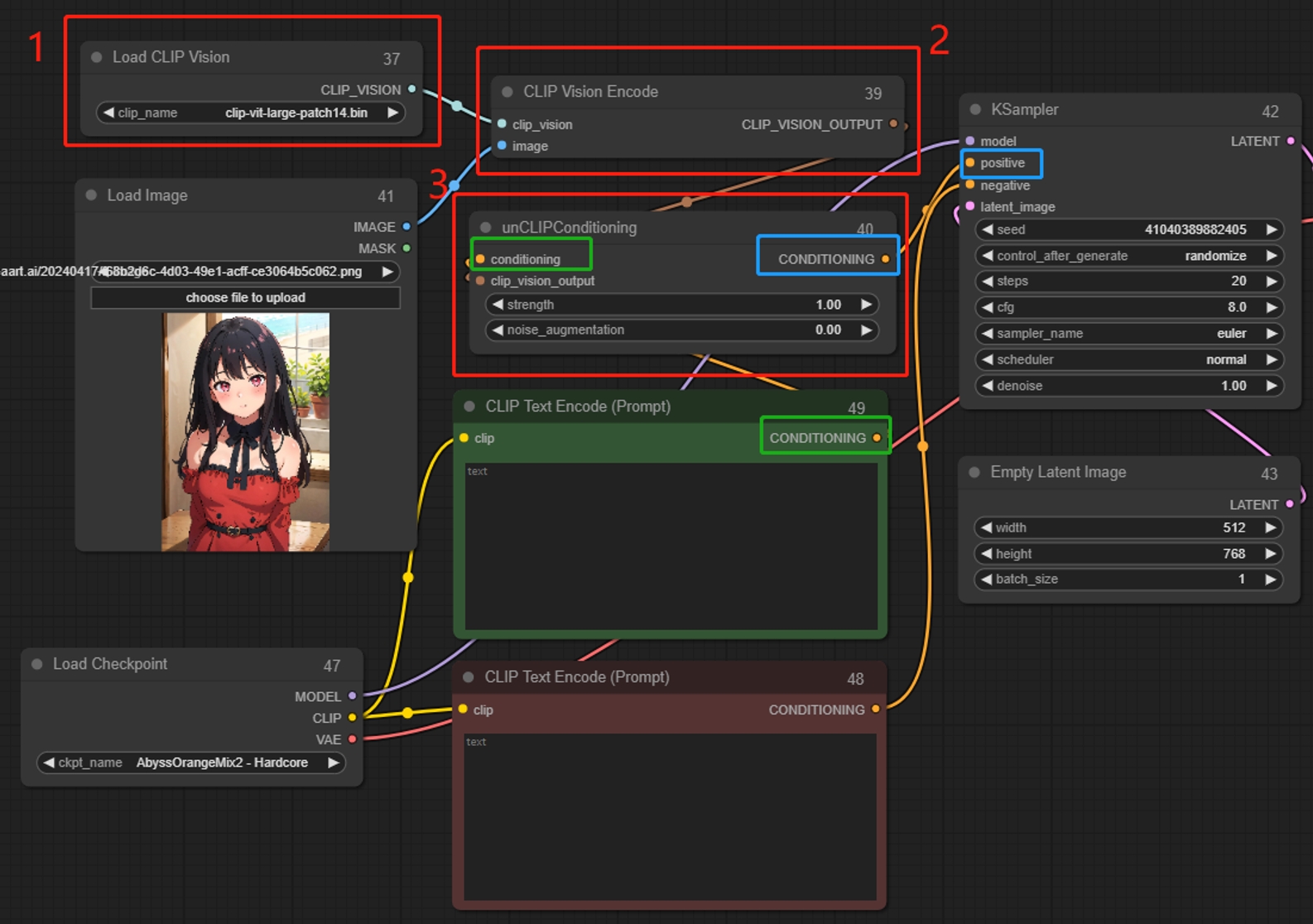

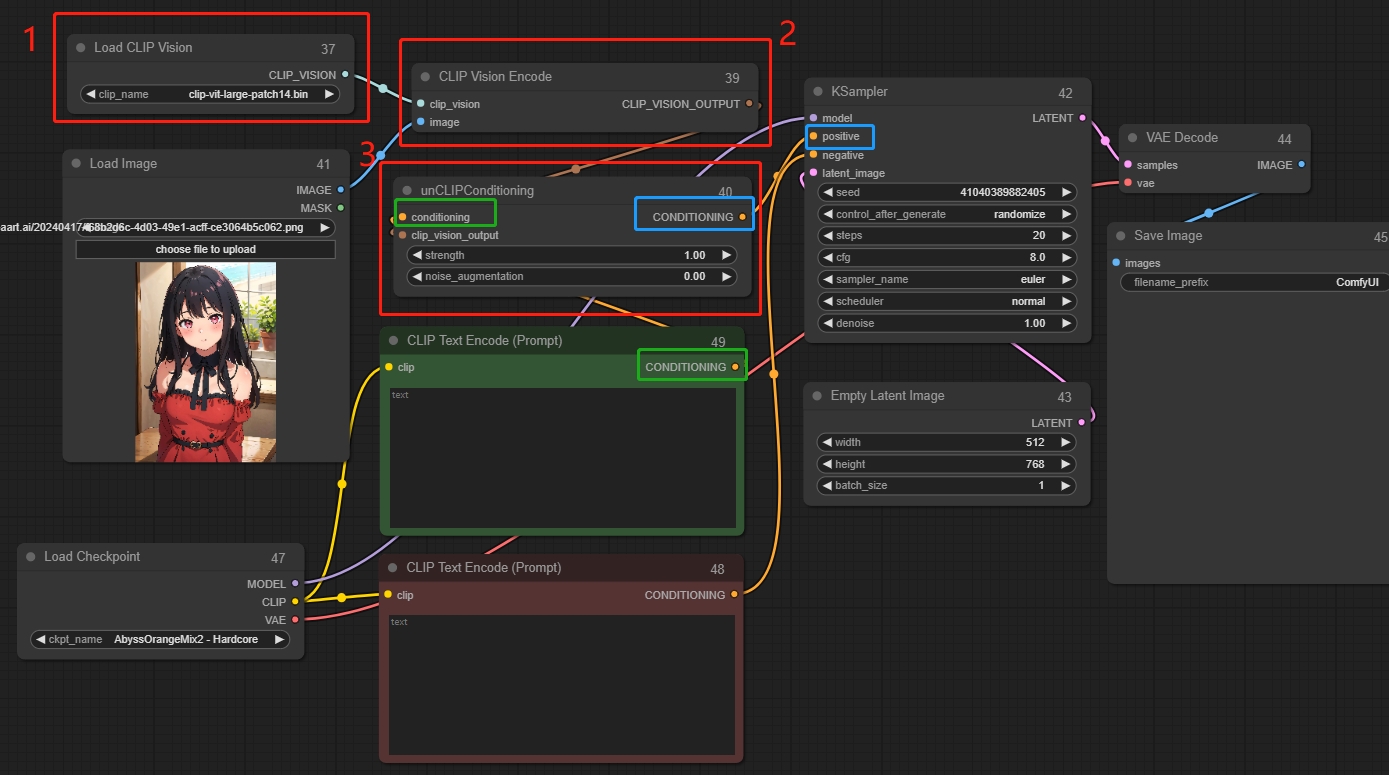

Load CLIP Vision (Carregar o modelo de visão do CLIP/Contrastive Language–Image Pre-training)

Decodificar a imagem para formar descrições (prompts), e depois convertê-las em entradas condicionais para o sampler. Baseado nas descrições decodificadas (prompts), gerar novas imagens similares. Múltiplos nós podem ser usados juntos. Adequado para transformar conceitos, coisas abstratas, usado em combinação com Clip Vision Encode.

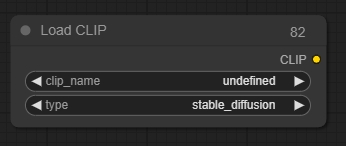

Load CLIP (Carregar o modelo CLIP)

O nó Load CLIP pode ser usado para carregar um modelo CLIP específico, modelos CLIP são usados para codificar prompts de texto que orientam o processo de difusão.

*Modelos de difusão condicional são treinados usando um modelo CLIP específico, usar um modelo diferente daquele com o qual foi treinado é improvável que resulte em boas imagens. O nó Load Checkpoint carrega automaticamente o modelo CLIP correto.

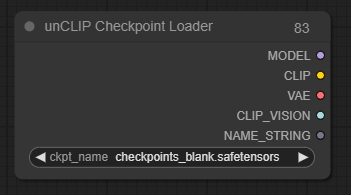

unCLIP Checkpoint Loader (Carregar Ponto de Verificação unCLIP)

O nó unCLIP Checkpoint Loader pode ser usado para carregar um modelo de difusão especificamente feito para trabalhar com unCLIP. Modelos de difusão unCLIP são usados para remover ruído de latentes condicionados não apenas no prompt de texto fornecido, mas também em imagens fornecidas. Este nó também fornecerá os modelos VAE e CLIP e CLIP vision apropriados.

*mesmo que este nó possa ser usado para carregar todos os modelos de difusão, nem todos os modelos de difusão são compatíveis com unCLIP.

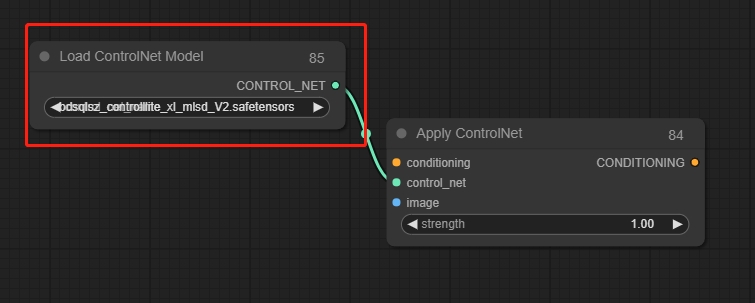

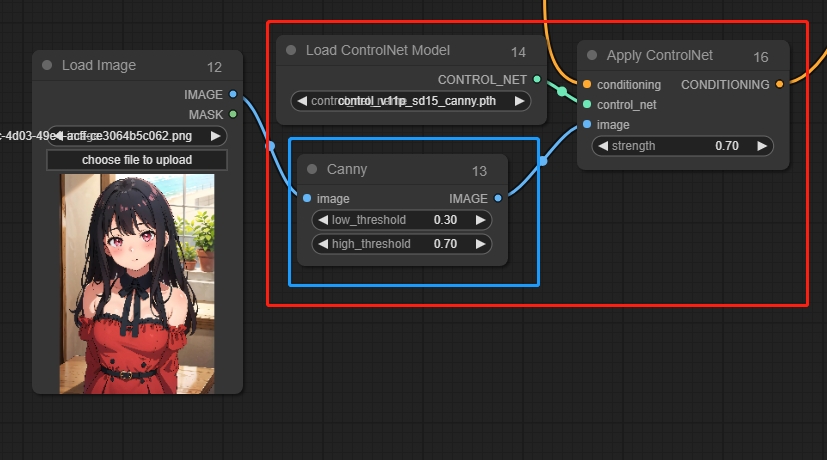

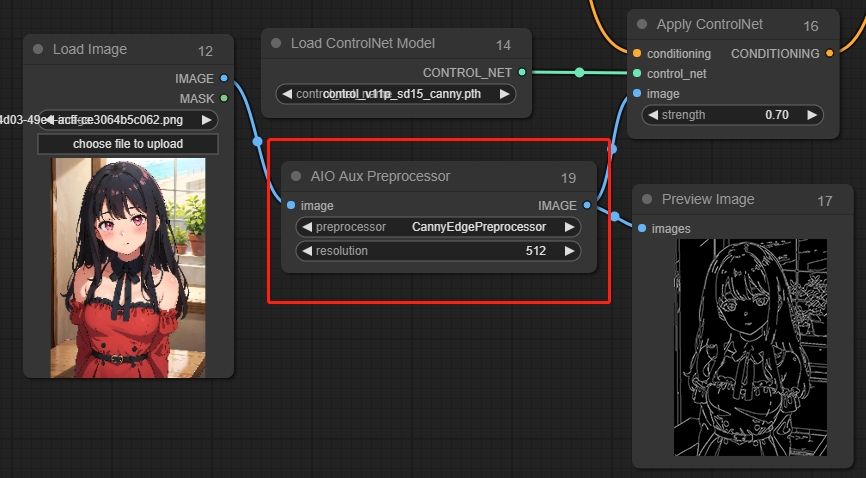

Load ControInet Model (Carregar Modelo ControlNet)

O nó Load ControlNet Model pode ser usado para carregar um modelo ControlNet, Usado em conjunto com Apply ControlNet.

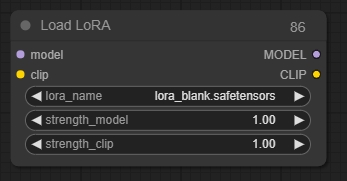

Load LoRA (Carregar LoRA)

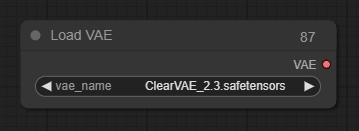

Load VAE (Carregar VAE/Autoencoder Variacional)

Load Upscale Model (Carregar Modelo de Aumento de Resolução)

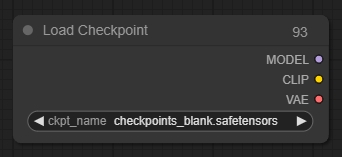

Load Checkpoint (Carregar Ponto de Verificação)

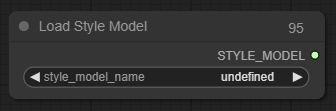

Load Style Model (Carregar Modelo de Estilo)

O nó Load Style Model pode ser usado para carregar um modelo de Estilo. Modelos de estilo podem ser usados para fornecer a um modelo de difusão uma dica visual sobre que tipo de estilo o latente sem ruído deveria ter.

*Apenas modelos de estilo T2IAdaptor são atualmente suportados

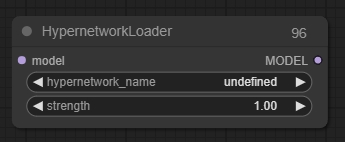

Hypernetwork Loader (Carregar Hiperrede)

O nó Hypernetwork Loader pode ser usado para carregar uma hiperrede. Similar aos LoRAs, eles são usados para modificar o modelo de difusão, para alterar a maneira como os latentes são limpos de ruído. Casos de uso típicos incluem adicionar ao modelo a capacidade de gerar em certos estilos, ou gerar melhor certos sujeitos ou ações. Pode-se até mesmo encadear múltiplas hiperredes para modificar ainda mais o modelo.

Conditioning (Condicionamento)

Apply ControlNet (Aplicar ControlNet)

Carregar modelo ControlNet, que pode conectar múltiplos nós ControlNet.

Parâmetros:

strength: Quanto maior o valor, mais forte a restrição na imagem.

*A imagem ControlNet deve ser a imagem pré-processada correspondente, por exemplo, a imagem pré-processada Canny corresponde ao gráfico pré-processado Canny. Portanto, é necessário adicionar nós correspondentes entre a imagem original e o ControlNet para pré-processá-la no gráfico pré-processado

CLIP Text Encode (Prompt) - Codificar Texto CLIP (Prompt)

Inserir prompts de texto, incluindo prompts positivos e negativos.

CLIP Vision Encode - Codificar Visão CLIP

Decodifique a imagem para gerar descrições (prompts) e, em seguida, converta-as em entradas condicionais para o sampler. Com base nas descrições (prompts) decodificadas, gere novas imagens semelhantes. Vários nós podem ser usados em conjunto. Adequado para transformar conceitos, coisas abstratas, sendo utilizado em conjunto com o Load Clip Vision.

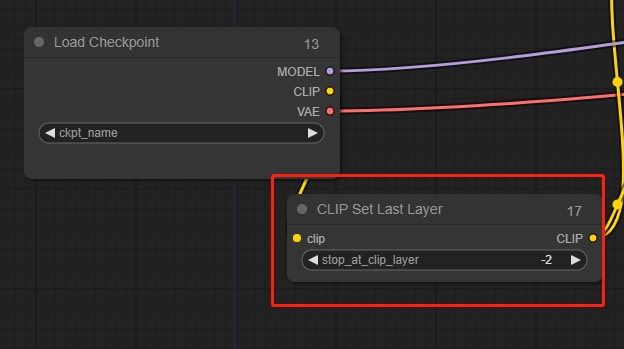

CLIP Set Last Layer (Definir Última Camada do CLIP)

Clip Skip, geralmente é definido como -2

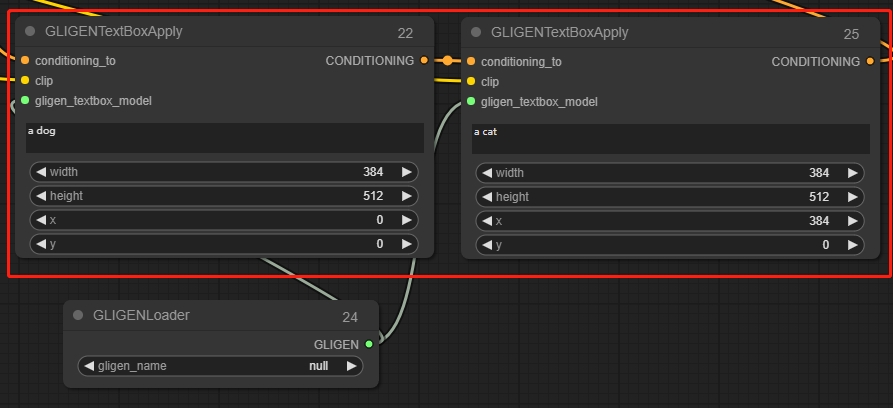

GLIGEN Textbox Apply (Aplicar Caixa de Texto GLIGEN)

Guia os prompts para gerar na parte especificada da imagem.

* A origem do sistema de coordenadas no ComfyUI está localizada no canto superior esquerdo.

unCLIP Conditioning (Condicionamento unCLIP)

As imagens codificadas pelo modelo de visão CLIP fornecem orientação visual adicional para o modelo unCLIP. Este nó pode ser encadeado para fornecer várias imagens como orientação.

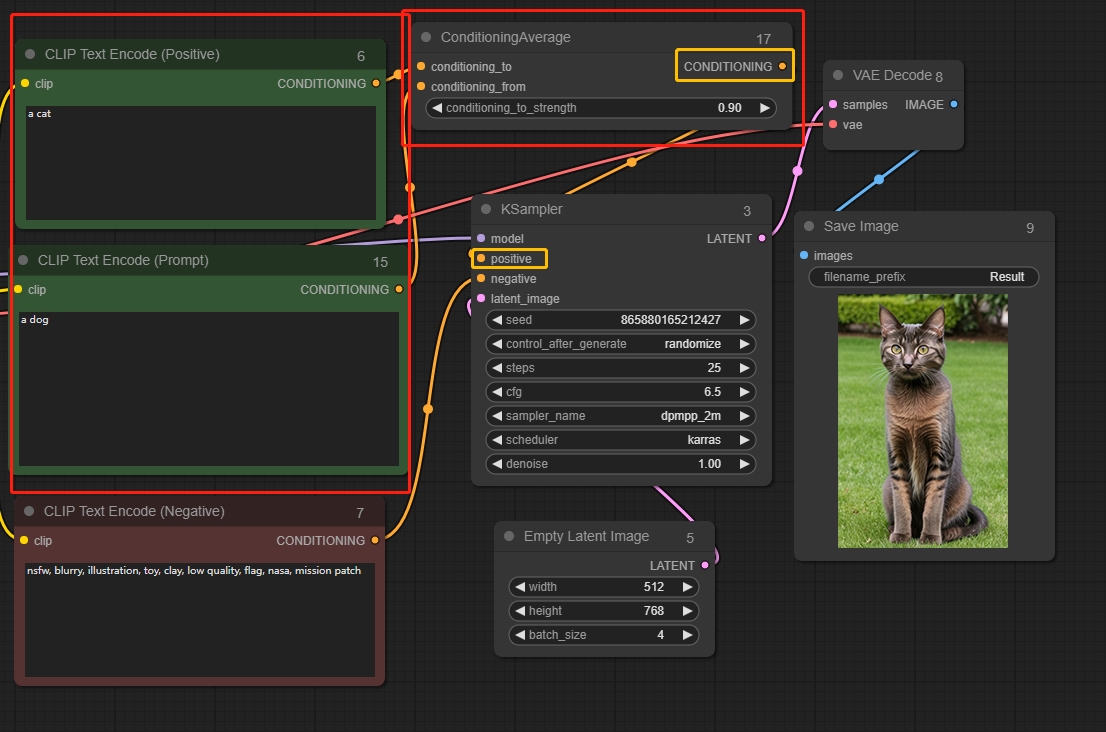

Conditioning Average (Média de Condicionamento)

Mistura duas informações com base em suas intensidades. Quando conditioning_to_strength é definido como 1, a difusão será influenciada apenas por conditioning_to. Quando conditioning_to_strength é 0, a difusão da imagem será influenciada apenas por conditioning_from.

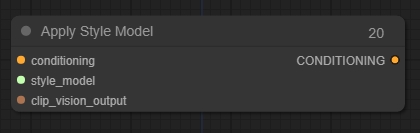

Apply Style Model (Aplicar Modelo de Estilo)

Pode ser usado para fornecer orientação visual adicional ao modelo de difusão, especialmente em relação ao estilo das imagens geradas.

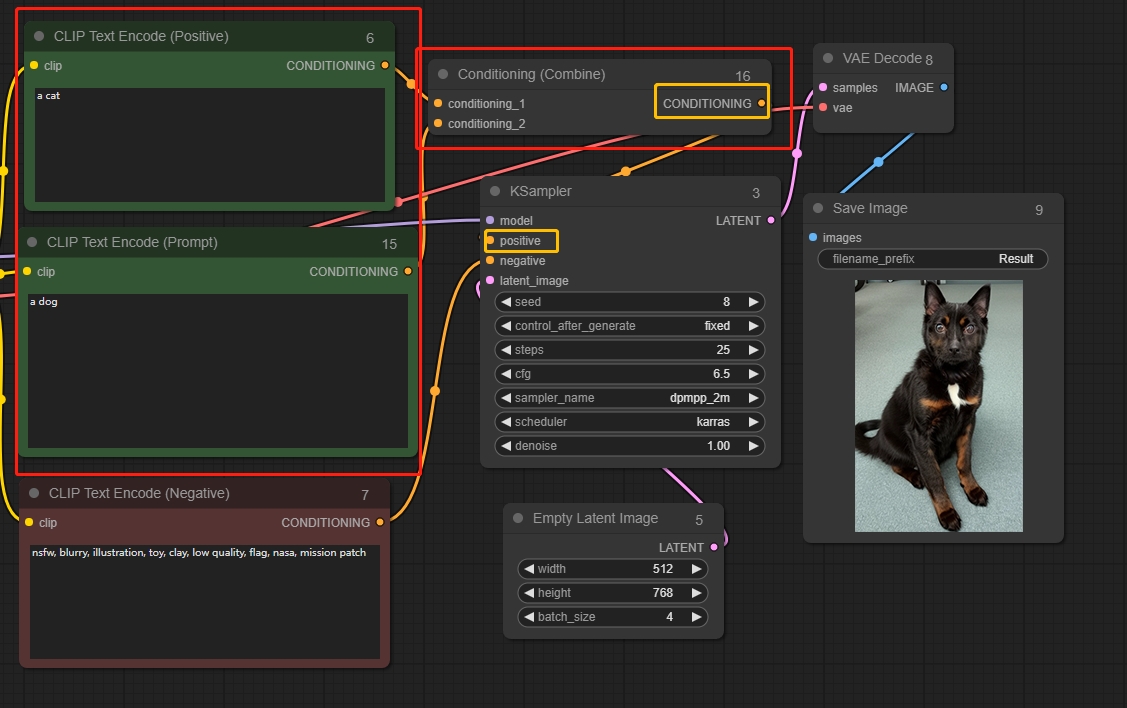

Conditioning (Combine) - Condicionamento (Combinar)

Mistura duas informações.

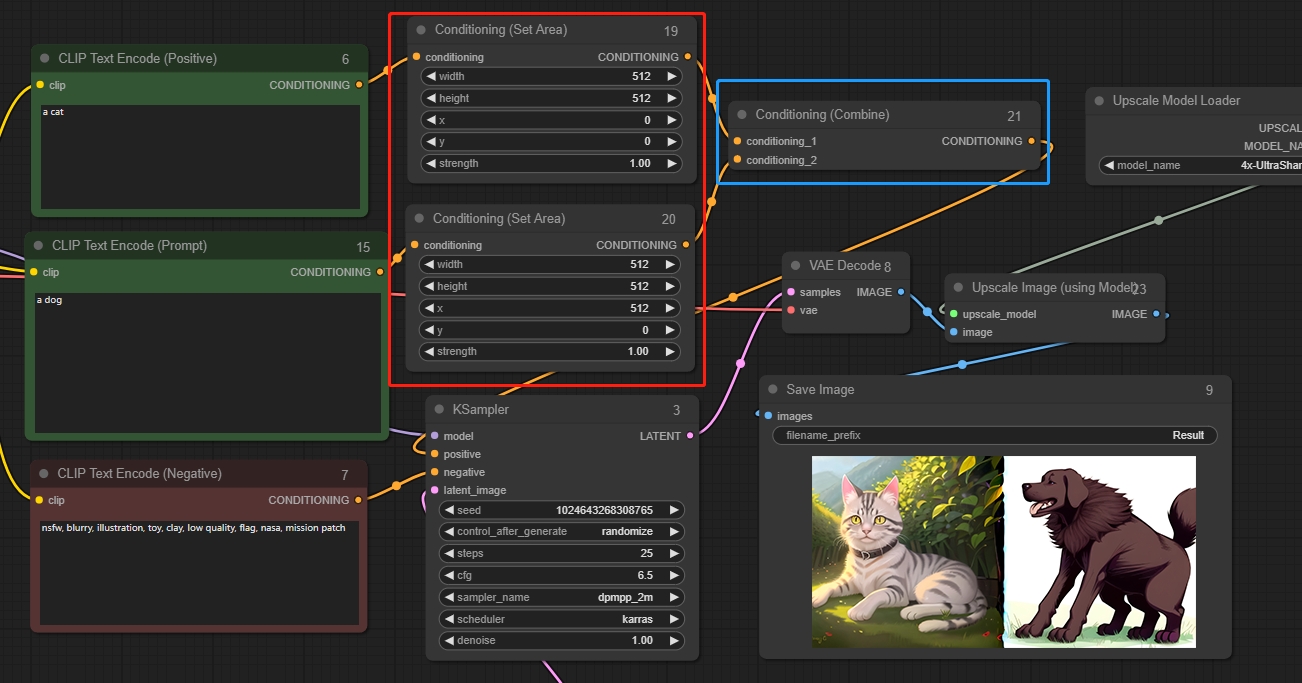

Conditioning (Set Area) - Condicionamento (Definir Área)

Conditioning (Set Area) pode ser usado para limitar a região afetada a uma área específica da imagem. Usado em conjunto com o Conditioning (Combine), permite melhor controle sobre a composição da imagem final.

Parâmetros:

width: A largura da região de controle

height: A altura da região de controle

x: A coordenada x da origem da região de controle

y: A coordenada y da origem da região de controle

strength: A intensidade da informação condicional

* A origem do sistema de coordenadas no ComfyUI está localizada no canto superior esquerdo.

Como mostrado na figura: defina o lado esquerdo como "gato" e o lado direito como "cachorro".

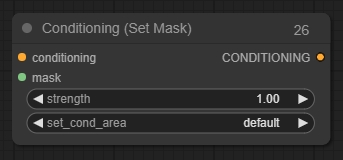

Conditioning (Set Mask) - Condicionamento (Definir Máscara)

Conditioning (Set Mask) pode ser usado para limitar um ajuste dentro de uma máscara especificada. Usado em conjunto com o nó Conditioning (Combine), permite melhor controle sobre a composição da imagem final.

Latent (Latente)

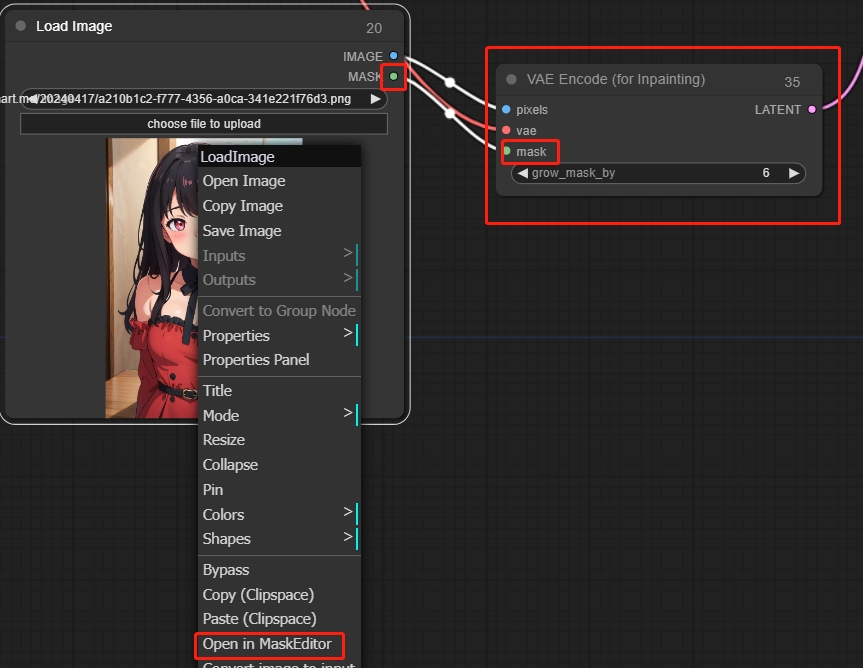

VAE Encode (for Inpainting) - Codificar VAE (para Restauração de Imagem)

Aplicável para repintura parcial, clique com o botão direito para realizar repintura parcial através do Open in MaskEditor.

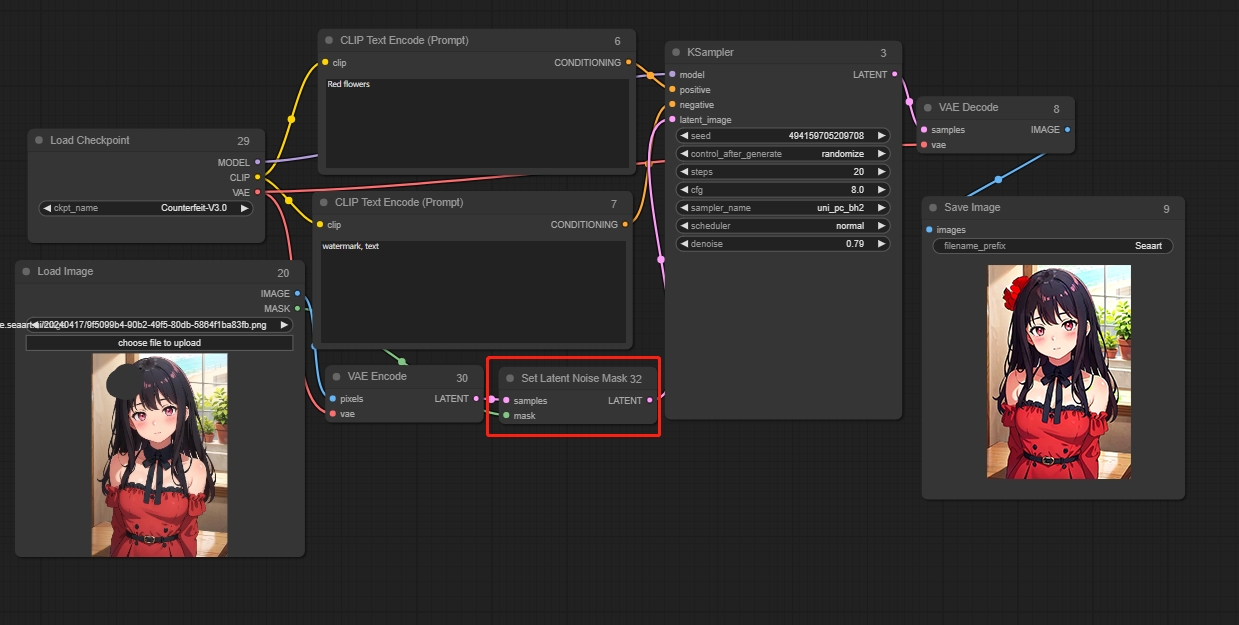

Set Latent Noise Mask (Definir Máscara de Ruído Latente)

O segundo método para repintura parcial envolve primeiro codificar a imagem através de um codificador VAE para transformá-la em conteúdo reconhecível no espaço latente. Em seguida, regenere a parte mascarada no espaço latente.

Comparado ao método VAE Encode (for Inpainting), esta abordagem pode entender melhor o conteúdo que precisa ser regenerado, resultando em menor probabilidade de gerar imagens incorretas. Ela fará referência à imagem a ser redesenhada.

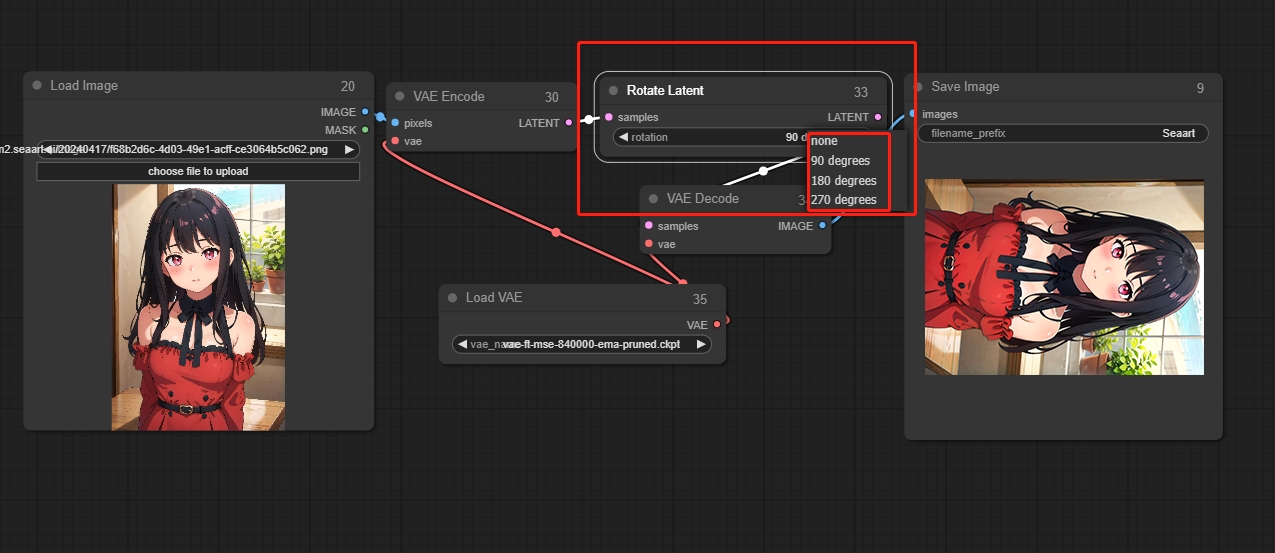

Rotate Latent (Rotacionar Latente)

Gira a imagem no sentido horário.

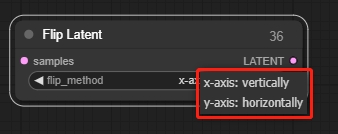

Flip Latent (Espelhar Latente)

Inverte a imagem horizontal ou verticalmente.

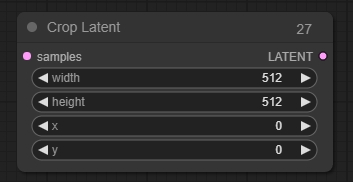

Crop Latent (Cortar Latente)

Usado para recortar a imagem em um novo formato.

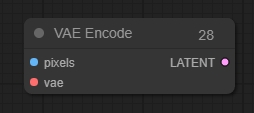

VAE Encode (Codificar VAE)

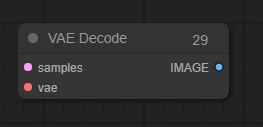

VAE Decode (Decodificar VAE)

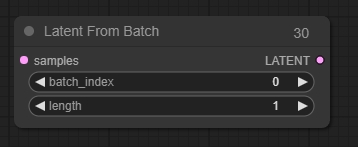

Latent From Batch (Latente do Lote)

Extrai imagens latentes de lotes. O nó Latent From Batch pode ser usado para selecionar uma imagem latente ou segmento de imagem de um lote. Isso é muito útil em fluxos de trabalho onde é necessário isolar imagens latentes específicas.

Parâmetros:

batch_index: O índice da primeira imagem latente a ser selecionada.

length: O número de imagens latentes a serem recuperadas.

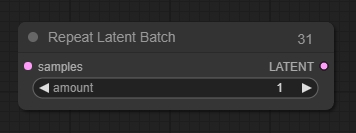

Repeat Latent Batch (Repetir Lote Latente)

Repete um lote de imagens, útil para criar múltiplas variações de uma imagem em um fluxo de trabalho IMG2IMG.

Parâmetros:

amount: O número de repetições.

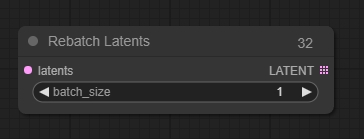

Rebatch Latents (Reagrupar Latentes)

Pode ser usado para dividir ou mesclar lotes de imagens em espaço latente.

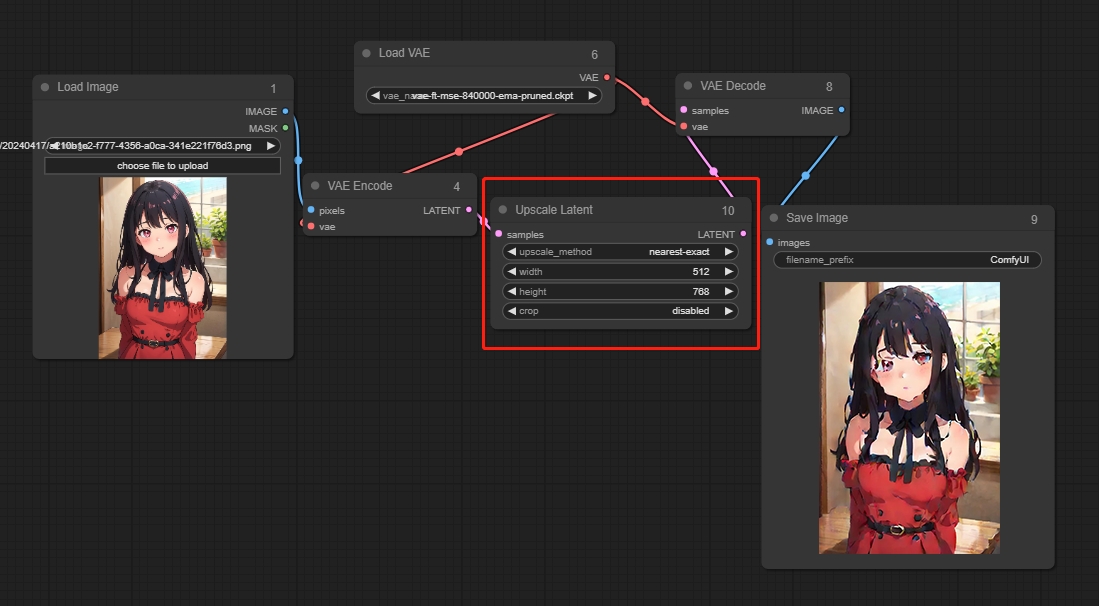

Upscale Latent (Aumentar Resolução do Latente)

Ajusta a resolução das imagens em espaço latente, com preenchimento de pixels.

Parâmetros:

upscale_method: O método de preenchimento de pixels.

width: A largura da imagem latente ajustada.

height: A altura da imagem latente ajustada.

crop: Indica se a imagem será recortada.

*O aumento de escala da imagem no espaço latente pode sofrer degradação ao ser decodificado pelo VAE. O KSampler pode ser usado para amostragem secundária para reparar a imagem.

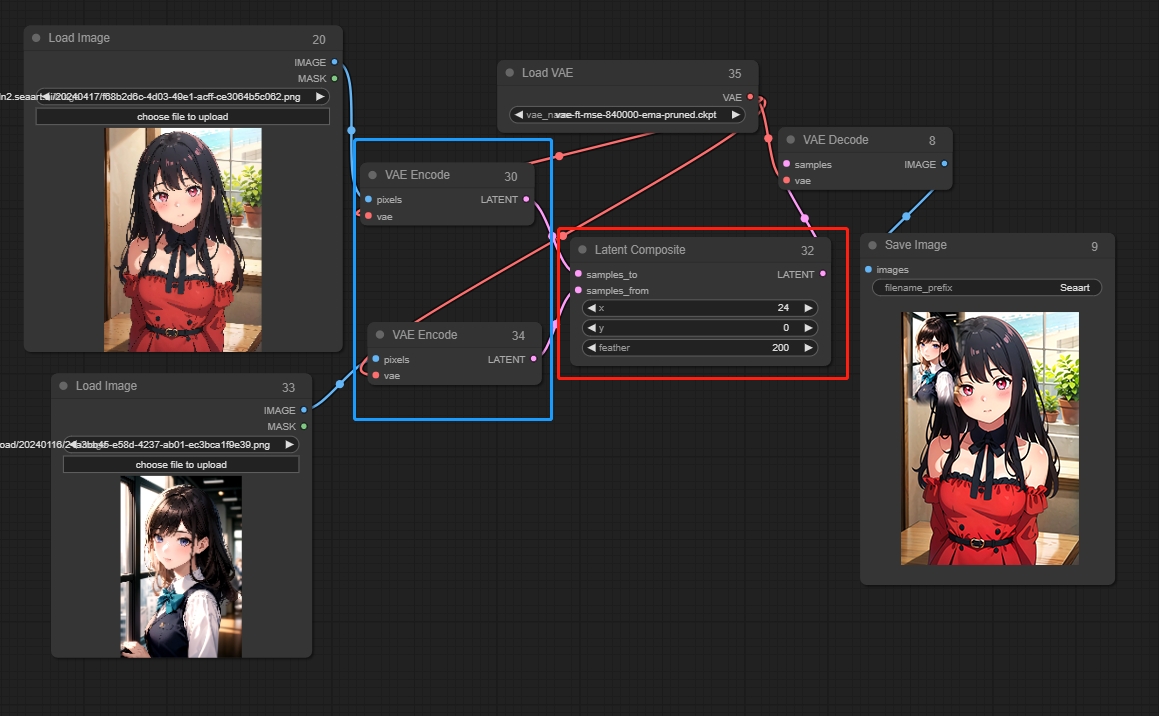

Latent Composite (Composição Latente)

Sobrepõe uma imagem sobre outra.

Parâmetros:

x: A coordenada x da posição de sobreposição da camada superior.

y: A coordenada y da posição de sobreposição da camada superior.

feather: Indica o grau de suavização nas bordas.

*A imagem precisa ser codificada (VAE Encode) no espaço latente.

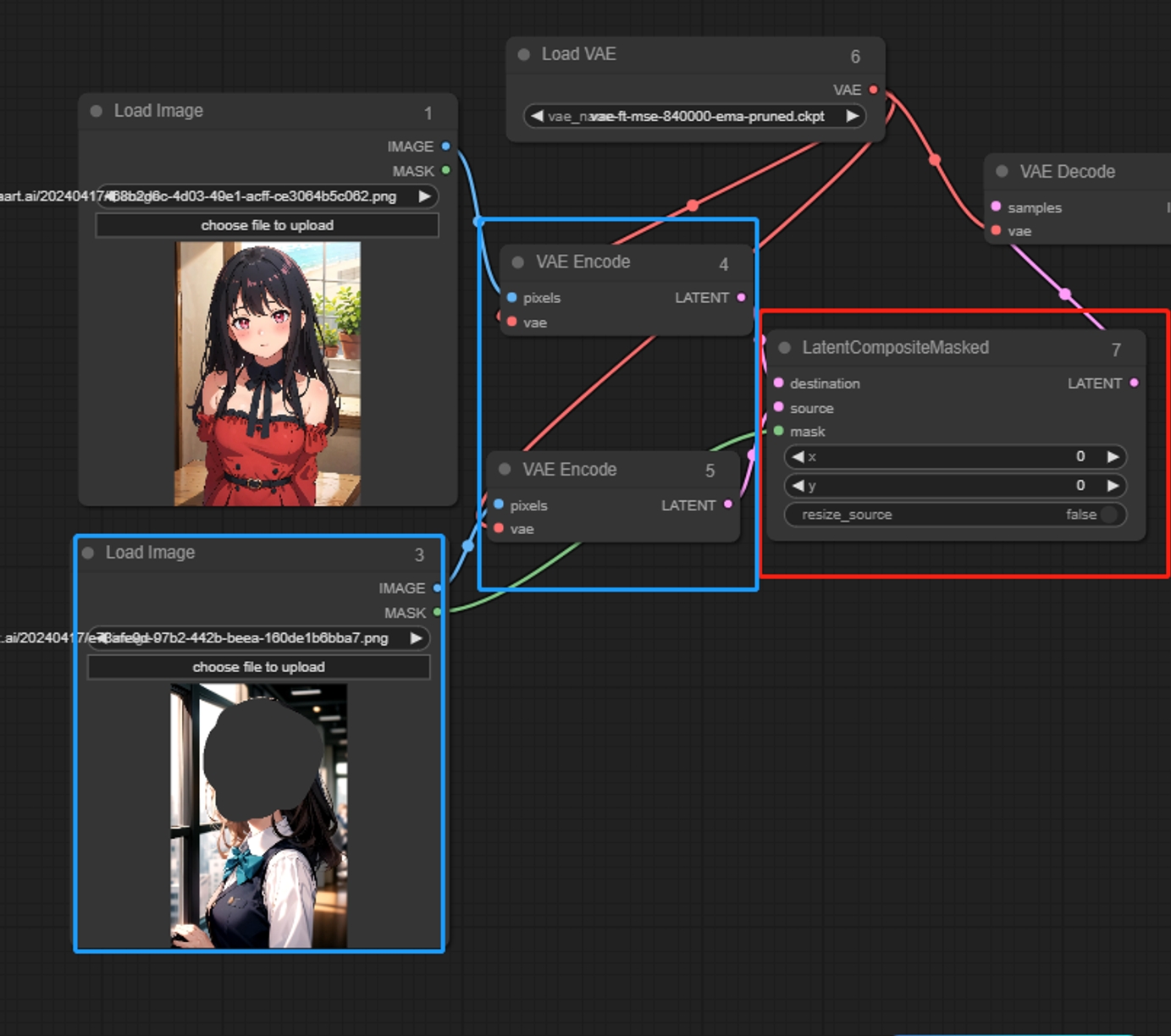

Latent Composite Masked (Composição Latente com Máscara)

Sobrepõe uma imagem com máscara sobre outra, sobrepondo apenas a parte mascarada.

Entrada:

destination: A imagem base no espaço latente.

source: A imagem sobreposta no espaço latente.

Parâmetros:

x: A coordenada x da região de sobreposição.

y: A coordenada y da região de sobreposição.

resize_source: Indica se a resolução da região mascarada será ajustada.

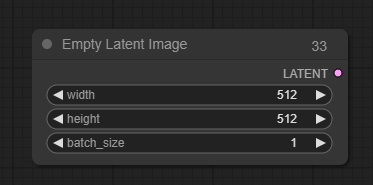

Empty Latent Image (Imagem Latente Vazia)

O Empty Latent Image pode ser usado para criar um conjunto de novas imagens latentes vazias. Essas imagens latentes podem então ser usadas em fluxos de trabalho como Text2Img, adicionando ruído e removendo ruído usando nós de amostragem.

Mask (Máscara)

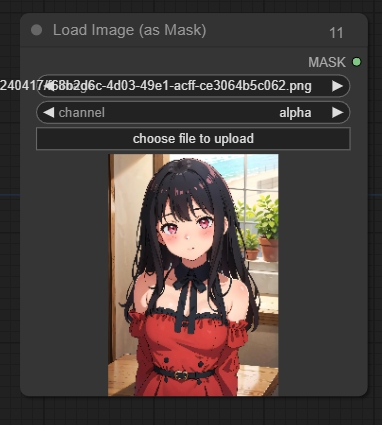

Load Image As Mask (Carregar Imagem como Máscara)

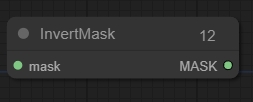

Invert Mask (Inverter Máscara)

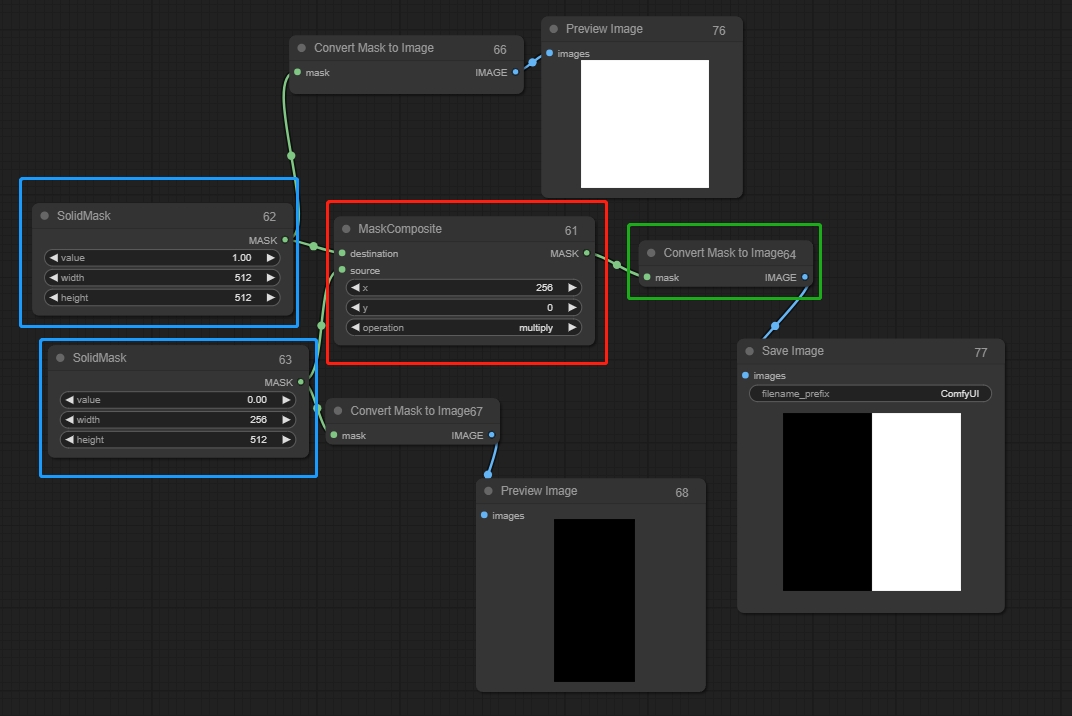

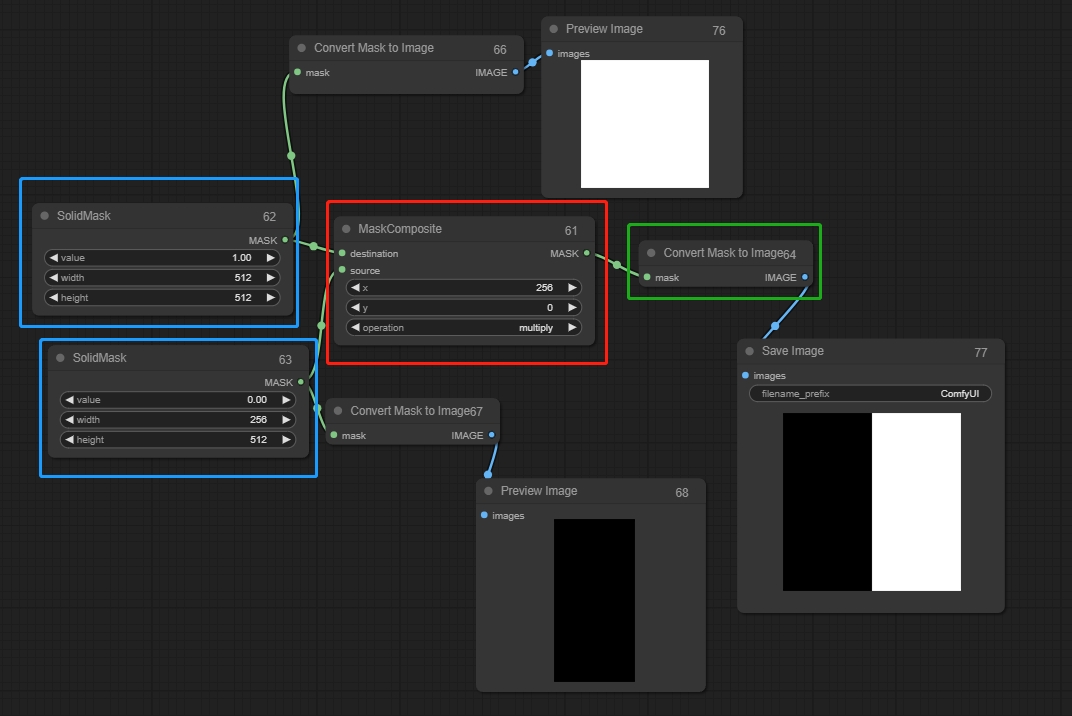

Solid Mask (Máscara Sólida)

Funciona como uma tela para gerar imagens e pode ser combinada com Mask Composite.

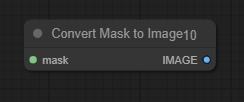

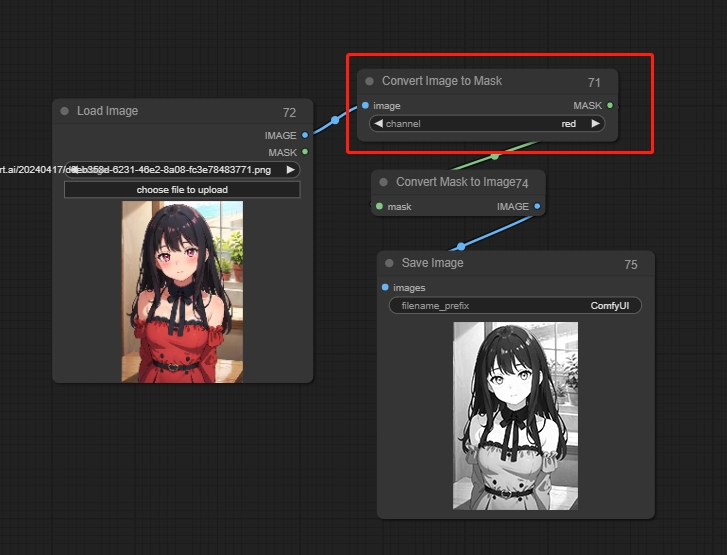

Convert Mask To Image (Converter Máscara em Imagem)

Convert Image To Mask (Converter Imagem em Máscara)

Converte a máscara em uma imagem em escala de cinza.

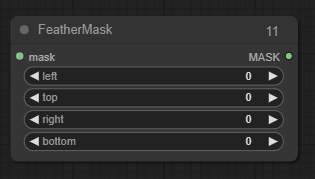

Feather Mask (Suavizar Máscara)

Aplica suavização à máscara.

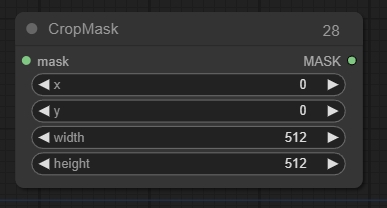

Crop Mask (Cortar Máscara)

Recorta a máscara para um novo formato.

Mask Composite (Composição de Máscara)

Cola uma máscara em outra, conectando Solid Mask. Um valor de 0 representa preto, que não será desenhado, enquanto um valor de 1 representa branco, que será desenhado. Os valores nas duas Solid Masks conectadas devem ser diferentes, caso contrário, a máscara não terá efeito.

Entrada:

destination(1): A máscara a ser colada, equivalente às dimensões finais da imagem.

source(0): A máscara a ser colada.

Parâmetros:

X,Y: Ajusta a posição da fonte.

operation: Quando a fonte é 0, use multiplicar; quando for 1, use adicionar.

Sampler (Amostrador)

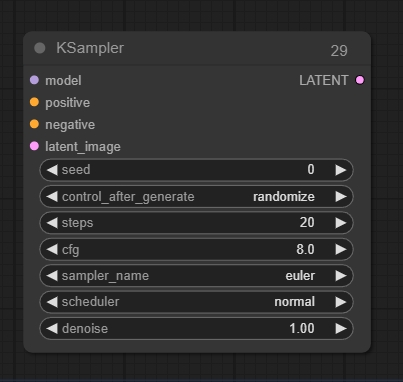

KSampler (Amostrador baseado no método Karras)

Entrada:

latent_image: A imagem latente a ser denoizada.

Saída:

LATENT: A imagem latente após a remoção de ruído.

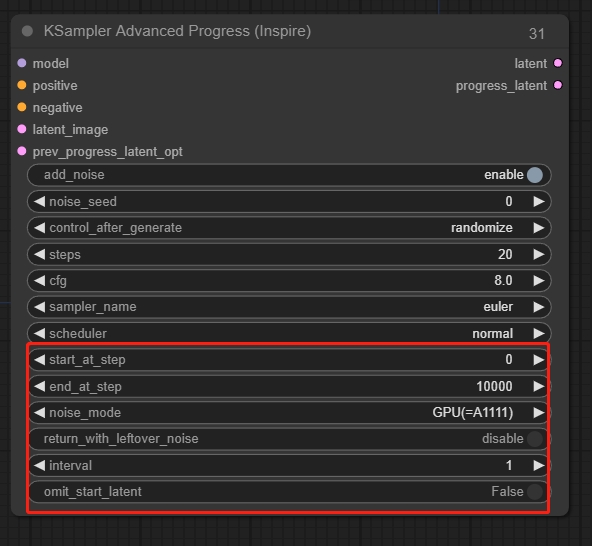

KSampler Advanced (KSampler Avançado)

Você pode controlar manualmente o ruído.

Avançado

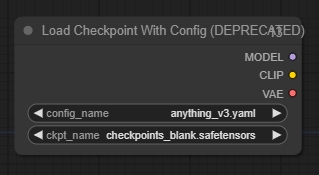

Load Checkpoint With Config (Carregar Ponto de Verificação com Configuração)

Carrega o modelo de difusão com base no arquivo de configuração fornecido.

Outros nós (Atualizando)

AIO Aux Preprocessor (Pré-processador Auxiliar AIO/Tudo em Um)

Selecione diferentes pré-processadores para gerar imagens correspondentes.

Last updated