Conversão de Imagem

Domine a conversão de imagens no ComfyUI! Este guia aprimora a conversão de imagem para imagem com controle preciso, referência facial e upscaling em alta definição.

Processo de Pensamento:

A conversão de imagem do ComfyUI é semelhante ao Img2Img do webui, onde uma imagem original é enviada e seu estilo é modificado pelo modelo. No entanto, para aumentar a precisão da conversão, podemos adicionar alguns novos passos:

I. Adicionar um nó de ampliação do modelo para controlar o tamanho da imagem original.

II. Aumentar a similaridade com a imagem original:

a. Usar ipadapter faceid para referenciar características faciais.

b. Fazer engenharia reversa dos prompts da imagem original.

c. Adicionar ControlNet (openpose, canny, depth).

III. Fazer o upscaling da imagem final.

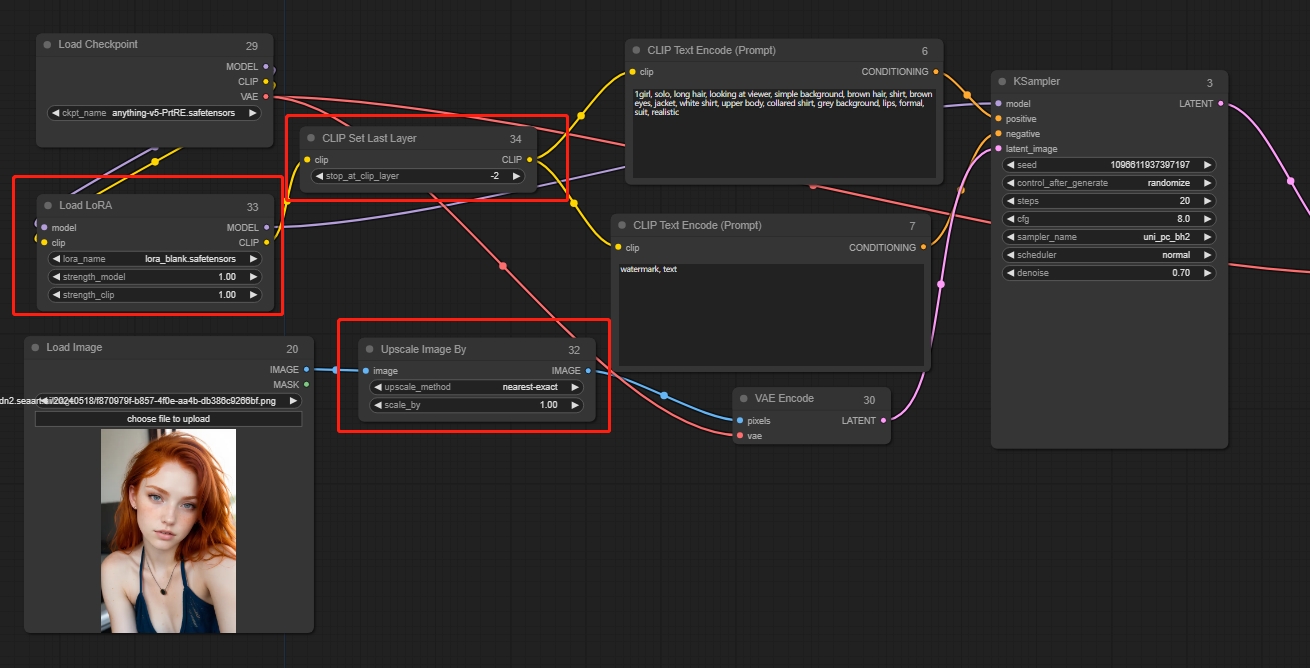

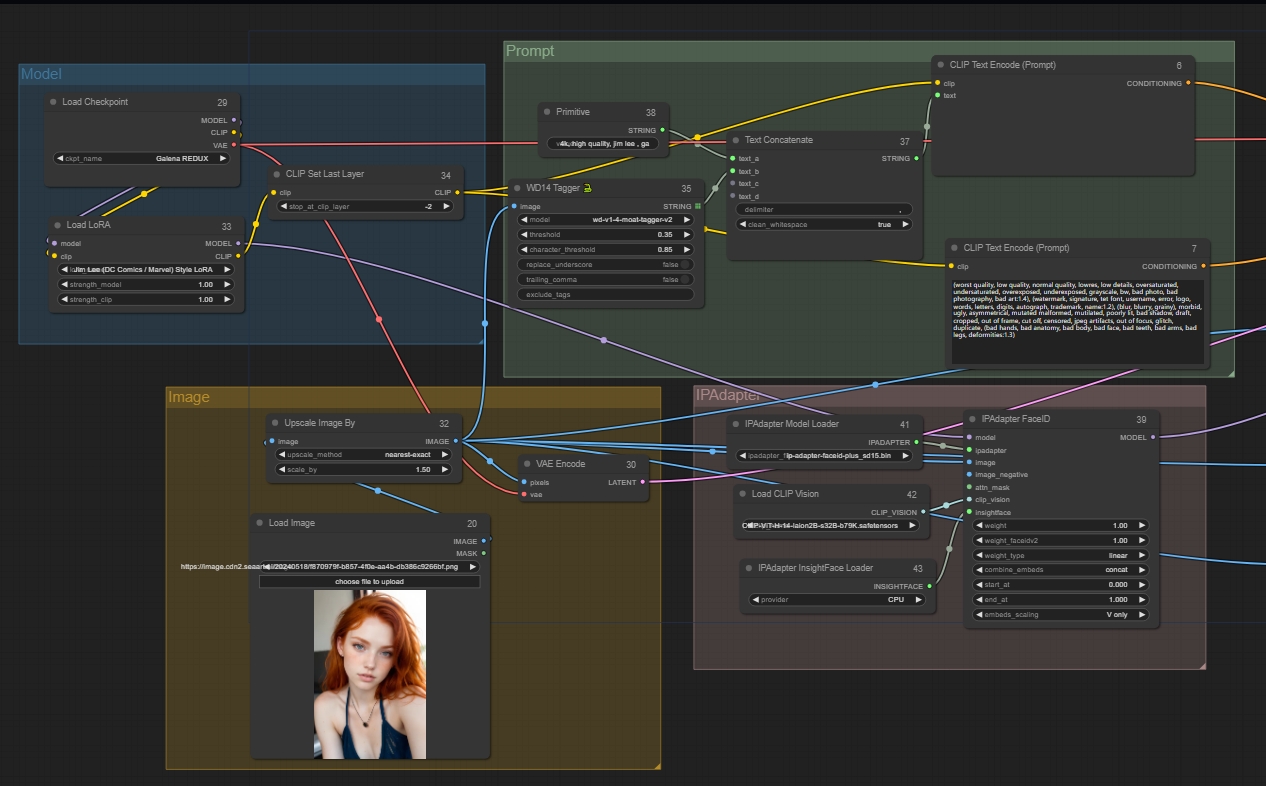

Passo 1: Construir o Grupo de Modelos

Podemos começar a construir com base no template Img2Img. Primeiro, adicione seletivamente um nó "Upscale Image By" atrás da imagem original para controlar o tamanho da imagem. Lora pode ser adicionado conforme a necessidade, ou não ser adicionado. Adicione um nó "CLIP Set Last Layer" conforme necessário, que também pode ser omitido. Este nó permite pular camadas e, por fim, conectar os nós correspondentes.

Adicione os nós:

Upscale Image By

CLIP Set Last Layer

Passo 2: Referenciar a Imagem Original

(Engenharia reversa de prompts + Ipadapter + Control Net)

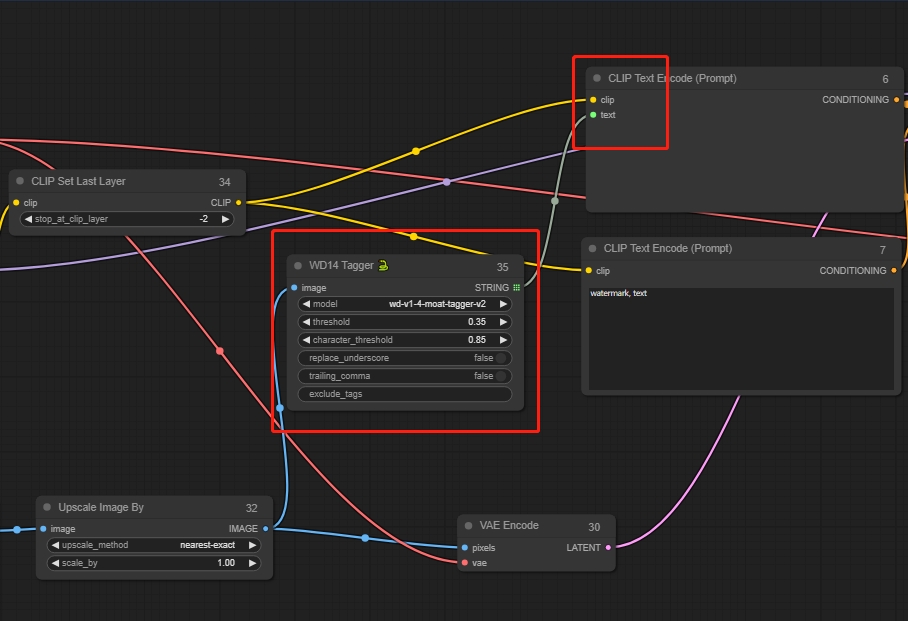

Engenharia reversa de prompts: nó WD14 Tagger

Clique duas vezes para pesquisar e adicionar o nó WD14 Tagger.

Conecte o nó de imagem.

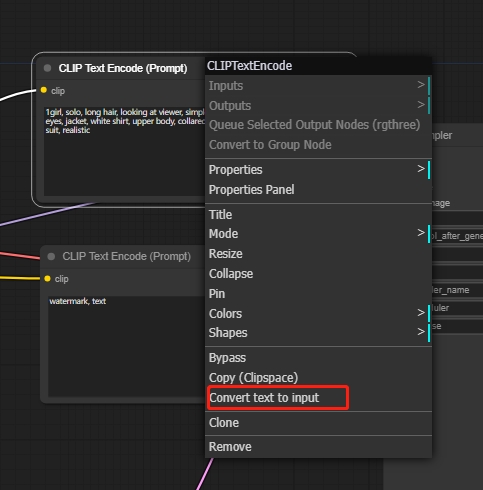

Clique com o botão direito no nó de prompts positivos e selecione "Converter texto em entrada" para conectar o WD14 Tagger ao nó de prompts positivos.

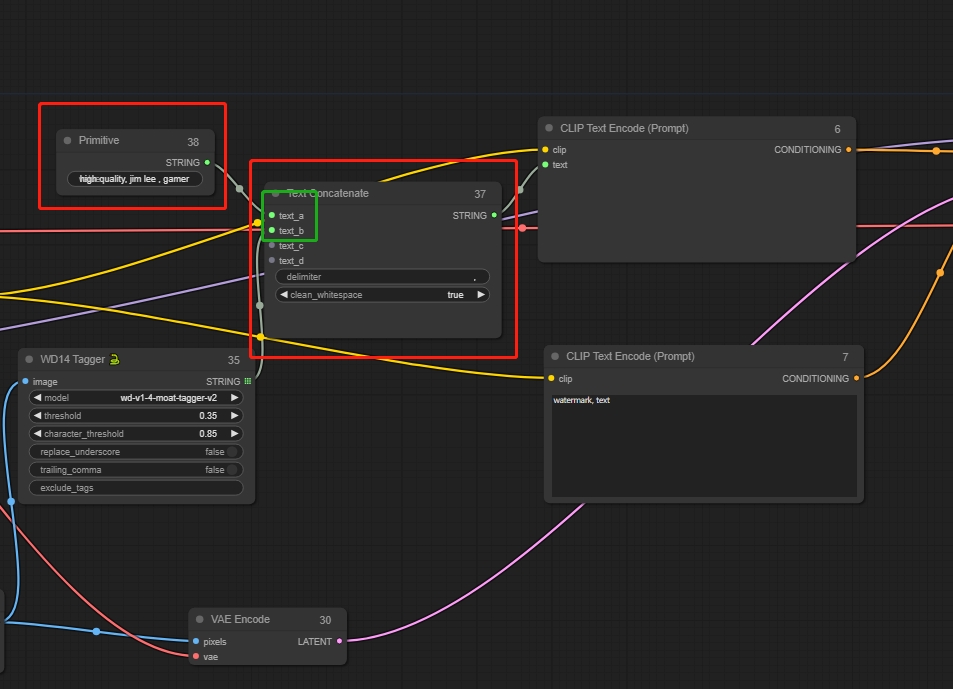

No entanto, isso só inclui os prompts da imagem. Se quiser adicionar outros prompts, é necessário criar um novo nó Text Concatenate, que pode conectar vários segmentos de prompts juntos.

Depois, crie um novo nó Primitive. O nó Primitive pode ser conectado a qualquer nó para se tornar um atributo relacionado.

Digite prompts adicionais no Primitive, como palavras de ativação do Lora, algumas palavras de qualidade, etc.

Neste ponto, os prompts incluem não só os extraídos da imagem, mas também os que inserimos.

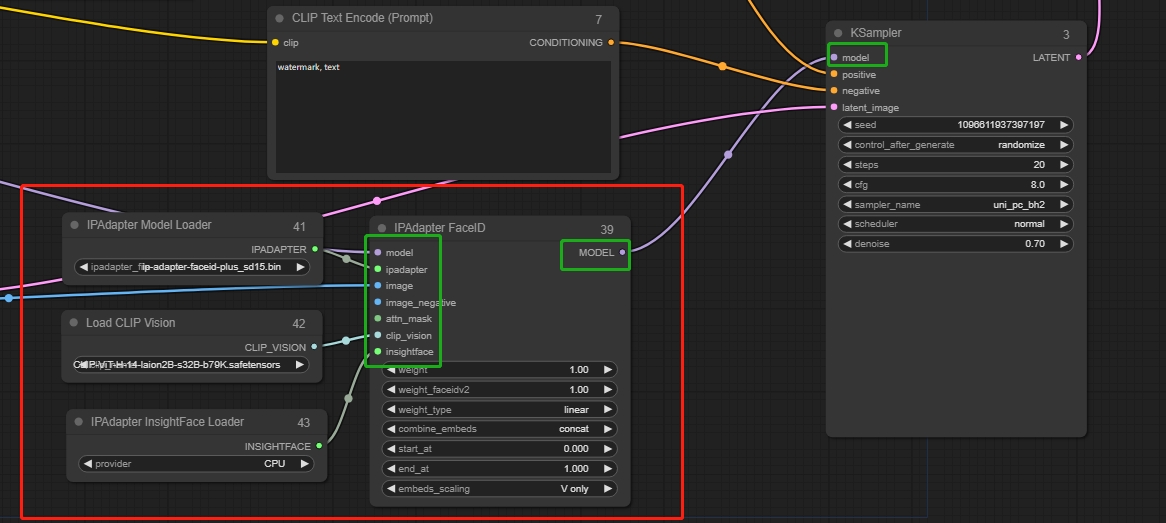

Em seguida, configure o IPadapter FaceID para referenciar características faciais:

Clique duas vezes para pesquisar IPadapter FaceID e combine os nós de entrada conforme necessário.

Após arrastar o nó, crie novos nós:

ipadapter → IPAdapter Model Loader

clip_vision → Load CLIP Vision

insightface → IPAdapter InsightFace Loader

Conecte a saída ao sampler.

Adicione os nós:

IPadapter FaceID

IPAdapter Model Loader

Load CLIP Vision

IPAdapter InsightFace Loader

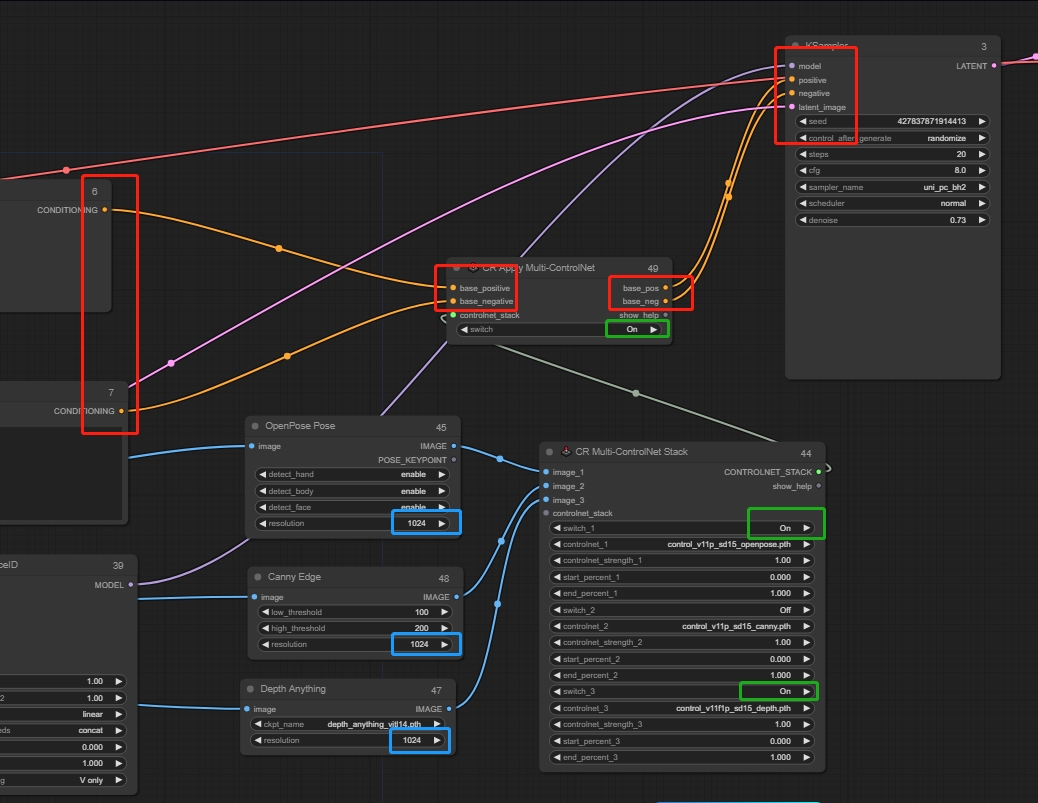

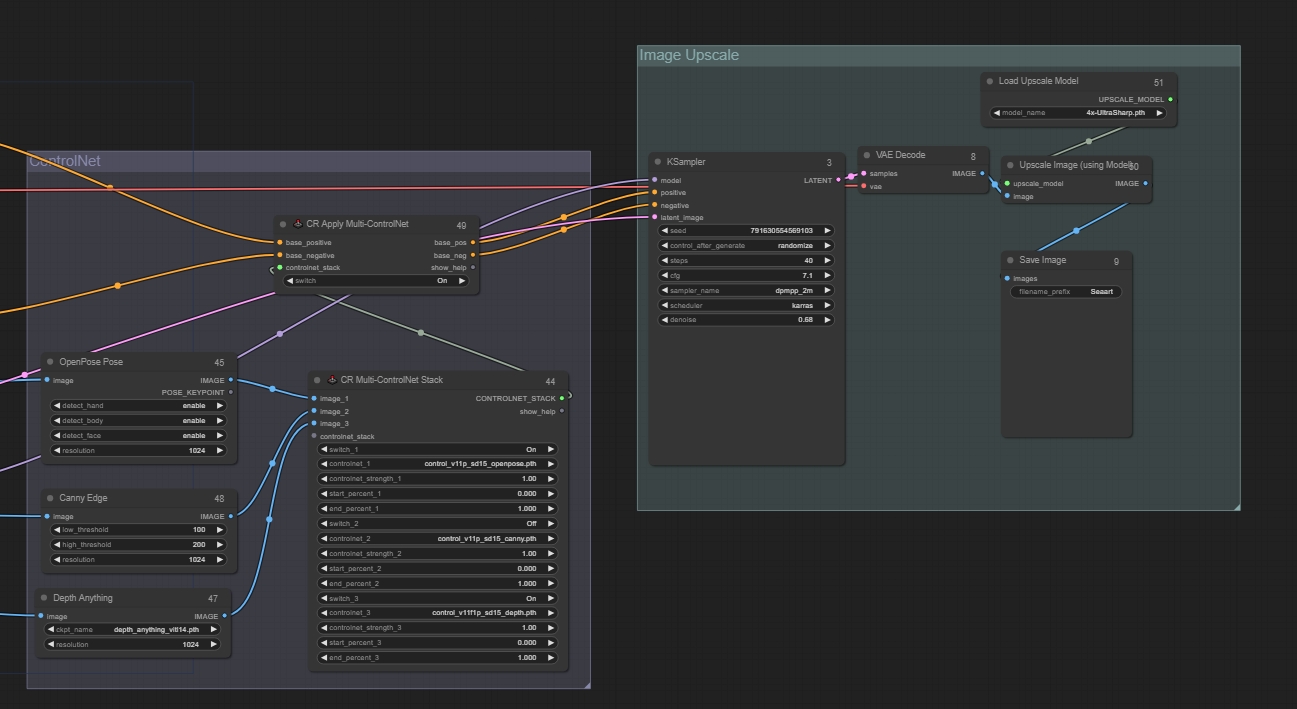

Configurar o ControlNet

Recomenda-se usar o nó CR Multi-ControlNet Stack, que permite adicionar múltiplos ControlNets. Depois, adicione os pré-processadores correspondentes. Recomenda-se usar OpenPose, Canny e Depth como ControlNet. Você pode adicionar ou remover conforme a necessidade visual final. Depois, adicione um nó de aplicação do ControlNet na saída: CR Apply Multi-ControlNet. Recomenda-se definir a resolução do pré-processador em 1024.

*Por fim, lembre-se de ativar os ControlNets que serão usados.

Entrada:

Conectado aos nós de prompts positivos e negativos.

Saída:

Conectado ao sampler.

Adicione os nós:

CR Multi-ControlNet Stack

CR Apply Multi-ControlNet

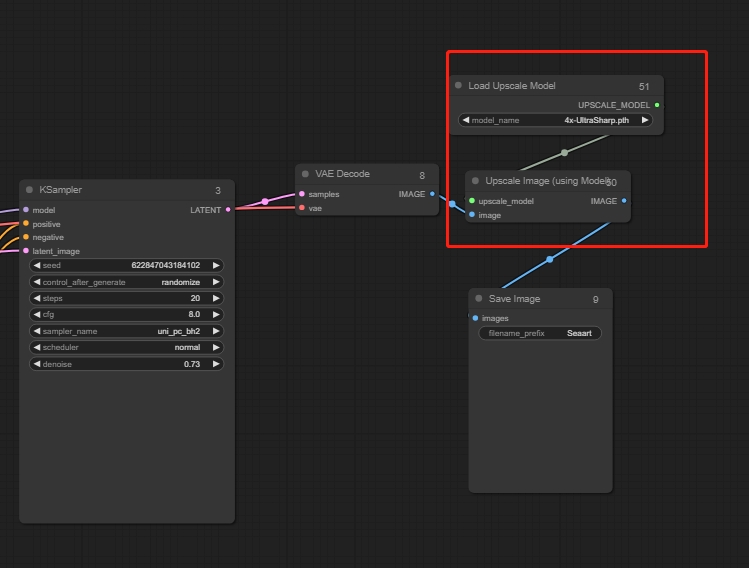

Passo 3: Restauração em Alta Definição

Depois de configurar o grupo de modelos e a referência à imagem original, podemos adicionar um passo de restauração em alta definição na saída final da imagem:

Adicione os nós: Upscale Image (usando Modelo)

Após montar os nós, você pode organizá-los em um grupo para facilitar a visualização.

Por fim, é necessário ajustar os parâmetros relevantes com base na imagem de saída, como ckpt, pesos do Lora, palavras de prompt, sampler, escala de redesenho, etc.

Parâmetros-chave para esta conversão incluem:

CLIP layer: -2

Upscale Image By: 1.5

steps: 40

sampler_name: dpmpp_2m

scheduler: karras

denoise: 0.7

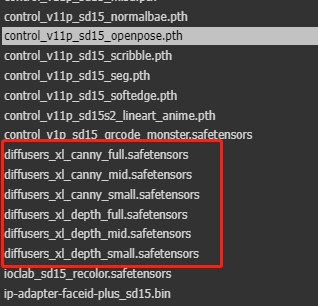

Nota: Se você escolher o modelo SDXL, também precisará do Lora correspondente ao SDXL e ajustar o ControlNet para SDXL; caso contrário, a saída da imagem falhará.

Acima está um fluxo de trabalho completo para conversão de imagem. Com base nisso, você também pode adicionar VAE ou FreeU_V2 para ajustar a imagem final:

FreeU_V2: Controla principalmente a cor e extrai algum conteúdo para otimização.

Load VAE: Ajusta cor e detalhes da imagem.

Com esse fluxo de trabalho, você pode alcançar conversões para diferentes estilos.

Last updated